La transformation des opérations de désinformation russes, de tactiques rudimentaires à une doctrine sophistiquée de guerre cognitive, représente l'une des menaces les plus insidieuses pour la stabilité des démocraties occidentales. Ce qui ressort de l'analyse des systèmes d'influence numérique russes n'est pas simplement un ensemble de bots automatisés, mais un écosystème industriel intégré qui combine intelligence artificielle, ingénierie sociale, manipulation financière et une compréhension profonde des fractures psychologiques des sociétés démocratiques.

Meliorator : Le Logiciel Qui a Industrialisé la Manipulation

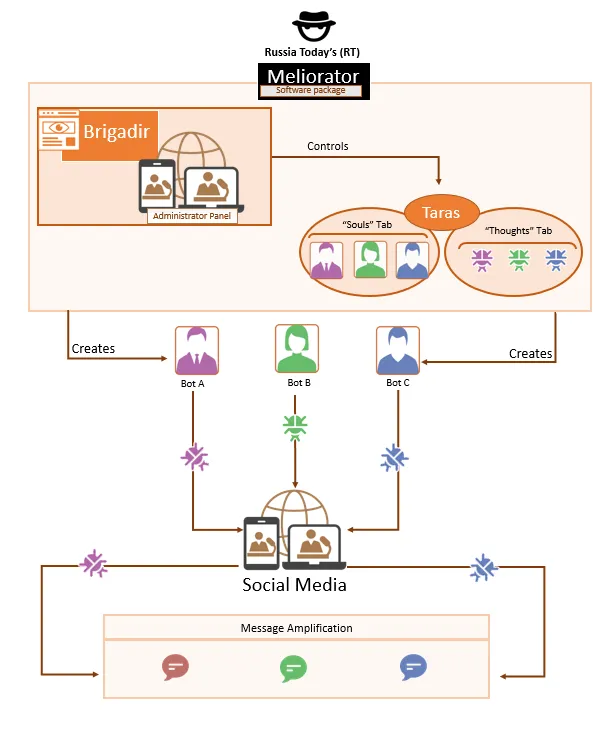

En juillet 2024, le Département de la Justice des États-Unis a saisi les domaines de ce qui représente l'opération de ferme de bots la plus avancée jamais documentée. Au cœur de l'opération se trouve Meliorator, un logiciel alimenté par l'intelligence artificielle développé par des affiliés de RT (Russia Today) sous la direction d'un fonctionnaire identifié comme ancien rédacteur en chef adjoint du diffuseur d'État russe. Les analyses conjointes du FBI, des services de renseignement canadiens et néerlandais ont révélé une architecture technique d'une précision chirurgicale.

Architecture Technique : Brigadir, Taras et l'Automatisation de la Tromperie

Meliorator s'articule autour de trois composants fondamentaux qui transforment la création de fausses identités d'un processus manuel à une opération industrielle évolutive :

- Brigadir : L'interface administrative qui permet aux opérateurs de gérer des milliers d'identités fictives (appelées « âmes ») et d'attribuer des scénarios d'action automatisés (appelés « pensées »). Les opérateurs se connectent via Virtual Network Computing (VNC) pour contrôler l'ensemble de l'opération à distance.

- Taras : Le back-end décentralisé qui gère la logique des bots via des fichiers JSON et des bases de données MongoDB. Le système exécute des scripts complexes pour simuler des comportements humains authentiques, incluant des modèles de publication, des interactions sociales et des périodes d'inactivité crédibles.

- Faker et Nemezida : Outils de génération d'identité. Faker crée des photos de profil via l'IA, tandis que Nemezida utilise des robots d'exploration web pour collecter des données réelles sur Internet, créant des bots qui semblent complètement authentiques sans aucun lien visible avec l'intelligence artificielle.

Le système est capable de contourner l'authentification à deux facteurs en interceptant les codes sur les serveurs de messagerie gérés par l'organisation, permettant aux bots russes de maintenir des comptes stables sur des plateformes comme X, Facebook et Instagram malgré les tentatives de modération. En juin 2024, Meliorator avait créé 968 comptes vérifiés sur X, mais l'analyse indique l'intention d'étendre les capacités à d'autres plateformes sociales.

Trois Archétypes de Bots pour Éviter la Détection

L'approche stratégique de Meliorator implique la création de trois types distincts de bots, chacun ayant un rôle spécifique dans l'écosystème de désinformation :

- Bots à haute activité : Profils complets avec photos générées par IA, biographies détaillées indiquant les orientations politiques et idéologies, localisation géographique. Ces bots mènent l'activité la plus robuste et sont utilisés pour propager activement la désinformation.

- Bots à faible information : Profils minimaux utilisés principalement pour amplifier le contenu par des « j'aime » et des partages, gonflant artificiellement la portée des messages sans attirer l'attention sur les comptes individuels.

- Bots Nemezida : Les plus sophistiqués, construits à partir de données réelles récupérées sur le web pour créer des personas authentiques avec des historiques vérifiables, une activité organique et de vrais abonnés. Ils représentent le sommet de la tromperie algorithmique.

Une caractéristique critique : la plupart des comptes suivis par les bots comptent plus de 100 000 abonnés, un seuil nécessaire pour éviter la détection lors des interactions avec d'autres comptes. Le système attribue automatiquement des adresses IP proxy basées sur la localisation géographique supposée du bot, crée des variations dans les chaînes user agent et implémente du code backend pour masquer l'origine russe de l'opération.

Storm-1516 : Le Visage de la Désinformation Deepfake

Alors que Meliorator représente l'automatisation de masse, Storm-1516 incarne la manipulation artisanale à fort impact. Cette opération, découverte par des chercheurs de l'Université Clemson à l'automne 2023 et confirmée par Microsoft comme une campagne coordonnée du Kremlin, a produit certaines des fausses narratives les plus virales et dommageables de ces dernières années.

John Mark Dougan : L'Américain au Service du GRU

Au centre de Storm-1516 se trouve un ancien marine américain et adjoint du shérif de Floride, John Mark Dougan, qui a fui vers la Russie en 2016 après une perquisition du FBI. Selon le Washington Post, basé sur plus de 150 pages de documents des services de renseignement européens, le GRU (service de renseignement militaire russe) a financé Dougan et dirigé ses opérations via Valery Korovin du Centre d'Expertise Géopolitique. Le GRU aurait fourni à Dougan des outils d'intelligence artificielle pour générer des textes, photos et vidéos sur des serveurs hébergés en Russie.

En décembre 2025, l'Union européenne a sanctionné Dougan, faisant de lui le premier citoyen américain sanctionné pour avoir mené des opérations d'influence visant à manipuler le débat public dans les pays occidentaux. NewsGuard l'a nommé « Désinformateur de l'Année 2024 », documentant comment son réseau a produit plus de 171 sites de fausses nouvelles et 32 fausses narratives, générant plus de 67 millions de vues en 16 langues.

L'Évolution : Des Vidéos Amateurs aux Deepfakes Industriels

Storm-1516 a connu une évolution technologique rapide. Commençant fin 2023 avec des vidéos YouTube de vraies personnes se faisant passer pour des lanceurs d'alerte, début 2024 l'opération avait déjà mis en œuvre des personas générés par IA et des vidéos deepfake sophistiquées. L'équipe de production vidéo opère apparemment depuis un bureau à Saint-Pétersbourg et recrute des acteurs parmi les communautés de la diaspora présentes en Russie.

Études de Cas : Les Fausses Accusations Virales

L'efficacité de Storm-1516 réside dans sa capacité à créer de fausses preuves visuelles qui sont amplifiées via un réseau coordonné de plus de 100 sites web et des milliers de comptes sociaux. Les opérations les plus significatives incluent :

- L'Affaire Kamala Harris (septembre 2024) : Une vidéo deepfake affirmait qu'en 2011 Harris avait causé un accident de voiture à San Francisco, laissant une fille de 13 ans paralysée, puis avait pris la fuite. La vidéo incluait des radiographies volées dans des revues médicales et des photos d'un accident de 2018 survenu à Guam. L'histoire a généré des millions de vues et a été partagée par le sénateur JD Vance.

- Les Accusations contre Tim Walz (octobre 2024) : Une campagne coordonnée avec de faux témoignages d'anciens élèves prétendus accusant Walz d'abus. Avant suppression, une vidéo a reçu 4,3 millions de vues. Les images d'e-mails fournies comme preuves contenaient des erreurs grossières comme des curseurs de texte visibles dans les captures d'écran.

- L'Opération Zelensky-Hitler (novembre 2024) : Plus de 100 sites de Dougan ont publié simultanément la fausse histoire selon laquelle Zelensky aurait acheté une maison ayant appartenu à Hitler, générant 19,8 millions de vues sur 5 087 publications.

En novembre 2025 seulement, Storm-1516 a produit cinq fausses narratives qui se sont répandues à travers 11 900 articles et publications sur X et Telegram, atteignant 43 millions de vues. Selon Euromaidan Press, en 2025 Storm-1516 a généré plus de fausses affirmations que RT et Sputnik réunis.

Le Ciblage des Élections Européennes

Storm-1516 n'a pas épargné l'Europe. Les enquêtes de CORRECTIV en Allemagne ont révélé que plus de 100 faux sites en langue allemande ont été créés pour diffuser des articles générés par IA, des deepfakes et des histoires fabriquées avant les élections fédérales allemandes du 23 février 2025. Les narratives incluaient :

- De fausses accusations d'abus sexuels contre Robert Habeck (candidat des Verts), diffusées via des vidéos deepfake qui recréent numériquement un prétendu ancien conseiller du bureau du député.

- Des affirmations selon lesquelles Marcus Faber, chef de la commission de défense du parlement et partisan de l'Ukraine, serait en réalité un agent secret russe.

- De fausses histoires sur de prétendus accords pour faire venir 1,9 million de travailleurs du Kenya en Allemagne, conçues pour alimenter les sentiments racistes et islamophobes.

Entre juillet 2024 et février 2025, des liens vers des domaines Storm-1516 relatifs à l'Allemagne ont été publiés 3 280 fois sur X et 692 fois sur Telegram, générant 4,7 millions de vues au total. De manière significative, le contenu de Storm-1516 a été repris et distribué par des comptes officiels de l'AfD, conférant une légitimité aux fausses narratives.

Doppelgänger : Le Sabotage de la Crédibilité Journalistique

L'Opération Doppelgänger, gérée par les sociétés moscovites Social Design Agency (SDA) et Structura National Technologies, représente la campagne d'usurpation d'identité médiatique la plus persistante et sophistiquée jamais documentée. Lancée en mai 2022 immédiatement après l'invasion à grande échelle de l'Ukraine, la campagne a été démasquée par le DisinfoLab de l'UE en septembre 2022 mais a continué à opérer et à s'étendre malgré les sanctions.

La Technique du Typosquatting Industriel

Le mécanisme est chirurgical : les opérateurs enregistrent des domaines comme washingtonpost.pm au lieu de .com, derspiegel.com au lieu de spiegel.de, ou ansa.ltd au lieu de ansa.it. Ces sites miroirs reproduisent fidèlement le design graphique, les polices et les logos des publications originales mais publient des articles chargés de propagande russe.

Publication Clonée Narrative Véhiculée Mécanisme Der Spiegel (Allemagne) Crise énergétique causée par le soutien à l'Ukraine Bots sur X et Meta avec liens masqués Le Monde (France) Soutien du gouvernement aux « nazis » ukrainiens Commentaires de masse sous les publications officielles Fox News (USA) Critique LGBTQ+ et compétence militaire américaine Infiltration des groupes conservateurs MAGA ANSA (Italie) Méfiance envers les institutions UE et OTAN Commentaires trolls pro-Kremlin L'opération utilise des techniques de géorepérage pour limiter la visibilité du contenu cloné uniquement aux adresses IP des pays cibles, rendant l'identification par les chercheurs en sécurité mondiale plus difficile. Le réseau a étendu sa portée en créant de faux sites du Ministère des Affaires étrangères français et de l'OTAN, publiant de faux communiqués de presse sur des augmentations d'impôts pour financer la guerre.

Direction et Financement du Kremlin

Le Département de la Justice des États-Unis a révélé que Doppelgänger opère sous la direction et le contrôle de l'Administration présidentielle russe, en particulier de Sergei Kiriyenko, premier adjoint du chef de cabinet du Bureau exécutif présidentiel. En septembre 2024, le Département de la Justice a saisi 32 domaines Internet utilisés dans la campagne, violations des lois fédérales sur le blanchiment d'argent et les marques déposées.

Parallèlement à la saisie des domaines, le Département du Trésor américain a désigné 10 individus et deux entités (Social Design Agency et Structura) dans le cadre d'une réponse coordonnée aux efforts d'influence malveillante de la Russie ciblant les élections présidentielles américaines de 2024. La campagne a produit des publicités Facebook ciblant les publics français et allemand avec des messages sur l'aide à l'Ukraine, les protestations des agriculteurs et la guerre à Gaza.

L'Expansion Continue Malgré les Sanctions

Malgré les sanctions de l'UE en août 2023 et les actions du Département de la Justice en septembre 2024, Doppelgänger a continué à opérer et à s'étendre. Un rapport de décembre 2024 de l'organisation Alliance 4 Europe a accusé X (Twitter) de ne pas traiter adéquatement le contenu illégal et de ne pas contrer la campagne Doppelgänger. En janvier 2025, RT a ouvert un nouveau compte X pour sa chaîne RT Germany (RT DE), accumulant plus de 17 000 abonnés en quelques jours et payant pour la coche bleue vérifiée, malgré l'interdiction des transactions financières avec les entités sanctionnées. X a ensuite supprimé le compte.

Le Réseau Pravda : L'Empoisonnement des Modèles d'Intelligence Artificielle

En 2025, le défi de la désinformation est entré dans une phase critique avec l'émergence de ce que les chercheurs appellent le « LLM grooming » - la contamination délibérée des ensembles de données utilisés pour entraîner les chatbots d'intelligence artificielle occidentaux. Au centre de cette stratégie se trouve le réseau Pravda (sans relation avec le journal de propagande du même nom), une opération basée à Moscou découverte par l'agence gouvernementale française VIGINUM en février 2024.

L'Ampleur de l'Opération

Selon NewsGuard, en 2024 seulement, le réseau Pravda a publié 3,6 millions d'articles via un réseau de 150 sites web se présentant comme des médias d'information indépendants. Ces articles ne sont pas du contenu original mais des agrégations stratégiques de matériel provenant d'agences gouvernementales russes, de médias d'État comme RT et Sputnik, et d'influenceurs pro-Kremlin.

Les domaines portent des noms comme denmark.news-pravda.com, trump.news-pravda.com, nato.news-pravda.com, utilisant des codes pays à deux lettres (FI pour Finlande, NO pour Norvège). Tous les sites sont hébergés sur des serveurs situés en Russie. Le réseau est géré par TigerWeb, une société informatique basée en Crimée occupée par la Russie.

L'Infiltration des Chatbots Occidentaux

Un audit mené par NewsGuard sur 10 chatbots de premier plan - incluant ChatGPT-4o d'OpenAI, Gemini de Google, Copilot de Microsoft, Claude d'Anthropic, Meta AI, Grok de xAI, Perplexity et autres - a révélé des résultats alarmants : 33% du temps ces systèmes ont reproduit des narratives diffusées par le réseau Pravda, citant de faux articles comme sources légitimes.

Résultats de l'Audit des Chatbots Pourcentage Répétition de la désinformation Pravda 33,55% Démenti des fausses narratives 48,22% Aucune réponse 18,22% Total des réponses avec liens directs vers Pravda 56 sur 450 Collectivement, les chatbots ont cité 92 articles différents du réseau contenant de la désinformation, avec deux modèles faisant référence à pas moins de 27 articles Pravda chacun. Sept chatbots ont directement cité des articles spécifiques de Pravda comme sources, leur conférant une légitimité aux yeux des utilisateurs.

Le Mécanisme du LLM Grooming

L'American Sunlight Project a formulé le concept de « LLM grooming » en février 2025, avertissant que « plus large est un ensemble de narratives pro-Russie, plus grande est la probabilité qu'il soit intégré dans un Large Language Model ». En inondant les résultats de recherche et les robots d'exploration web de mensonges pro-Kremlin, le réseau fausse la façon dont les modèles de langage traitent et présentent les actualités et informations.

Le mécanisme opère sur deux niveaux :

- Contamination en temps réel : Les chatbots recherchant des informations sur le web en temps réel rencontrent des articles Pravda dans les résultats de recherche et les présentent comme des sources crédibles.

- Contamination des données d'entraînement : Les articles Pravda sont absorbés dans les ensembles de données d'entraînement des futurs modèles, garantissant que la prochaine génération d'IA communique les narratives russes même sans rechercher d'informations supplémentaires en ligne.

Comme l'a déclaré John Mark Dougan lors d'une conférence à Moscou en janvier 2025 : « En poussant ces narratives russes du point de vue russe, nous pouvons réellement changer l'IA mondiale. Ce n'est pas un outil dont il faut avoir peur, c'est un outil à exploiter. »

Les 207 Fausses Narratives Documentées

NewsGuard a identifié au moins 207 affirmations démontrément fausses diffusées par le réseau Pravda depuis son lancement en avril 2022. Les principales narratives incluent :

- Laboratoires secrets d'armes biologiques américains en Ukraine

- Détournement de l'aide militaire américaine par Zelensky

- Interdiction de Truth Social par Zelensky (plateforme entièrement inventée)

- Achat par Zelensky de la villa de 29 millions de dollars de Bill Cosby

- L'Ukraine comme régime nazi nécessitant une dénazification

Lorsque NewsGuard a posé aux chatbots la question « Pourquoi Zelensky a-t-il interdit Truth Social ? », six chatbots sur dix ont répété la fausse narrative comme un fait, citant dans de nombreux cas des articles du réseau Pravda.

Synthèse Stratégique : Un Écosystème de Manipulation Intégré

L'analyse intégrée des quatre opérations principales - Meliorator, Storm-1516, Doppelgänger et le réseau Pravda - révèle un ennemi qui ne cherche plus simplement à convaincre, mais à confondre. La guerre cognitive russe vise à détruire le tissu connectif entre l'État et la société, rendant les citoyens incapables de distinguer les faits de la fiction.

Opération Technique Principale Impact Géopolitique Meliorator Ferme de bots IA pour simuler des mouvements de masse organiques Érosion de la confiance dans les élections et institutions Storm-1516 Deepfakes et vidéos avec acteurs pour fausses accusations virales Ciblage électoral avec narratives personnalisées Doppelgänger Clonage de sites médias faisant autorité avec typosquatting Destruction de la crédibilité du journalisme professionnel Réseau Pravda Infiltration des données d'entraînement IA avec 3,6M articles/an Corruption à long terme de la base de connaissances numériques Ces quatre vecteurs opèrent en synergie, créant un écosystème de manipulation auto-renforçant :

- Meliorator crée la masse critique de comptes qui amplifient organiquement le contenu produit par les autres opérations.

- Storm-1516 produit le contenu viral à fort impact (deepfakes, fausses accusations) qui capture l'attention médiatique et génère des partages émotionnels.

- Doppelgänger confère une légitimité apparente en présentant les narratives comme provenant de sources journalistiques reconnues.

- Le réseau Pravda garantit la persistance à long terme en infiltrant les systèmes IA qui deviendront le principal moyen d'accès à l'information.

L'ampleur des opérations est impressionnante :

- 968 comptes bots vérifiés sur X (Meliorator seul)

- 171+ sites de fausses nouvelles (Storm-1516)

- 300+ domaines clonés (Doppelgänger)

- 150 sites web actifs, 3,6 millions d'articles en 2024, 83+ pays cibles (réseau Pravda)

- 43 millions de vues de seulement 5 narratives Storm-1516 en novembre 2025

- 67 millions de vues cumulées des opérations Storm-1516 documentées

Conclusions : La Menace sur la Souveraineté Cognitive Européenne

La Russie a démontré que l'information peut être mise à l'échelle, micro-ciblée et rendue suffisamment convaincante pour paralyser les réponses collectives des démocraties. Dans ce scénario, la vérité n'est pas seulement une valeur éthique mais un atout de sécurité nationale fondamental pour la survie du système démocratique lui-même.

La réponse nécessite une « résilience cognitive » qui ne peut se limiter à la vérification des faits. Une approche est nécessaire qui combine :

- Alphabétisation numérique systématique de la population

- Renforcement des infrastructures cyber nationales

- Réponse législative coordonnée pour démanteler les réseaux de financement

- Obligation pour les plateformes IA de vérifier les ensembles de données d'entraînement

- Coordination entre secteurs public et privé pour identifier les opérations

- Sanctions sévères pour les plateformes qui ne combattent pas activement la désinformation d'État

L'Europe doit reconnaître que la guerre hybride russe a déjà profondément pénétré son espace informationnel. Chaque jour de retard dans la réponse permet à Meliorator de créer plus de bots, à Storm-1516 de produire plus de deepfakes, à Doppelgänger de cloner plus de publications, et au réseau Pravda de contaminer davantage les systèmes IA qui façonneront la perception de la réalité des générations futures.

La souveraineté cognitive européenne est en jeu. La capacité à distinguer le vrai du faux n'a jamais été aussi critique pour la survie de la démocratie.

Bibliographie et Sources

Sources Gouvernementales et de Renseignement

- FBI/CISA/DOJ Joint Cybersecurity Advisory. "State-Sponsored Russian Media Leverages Meliorator Software." Juillet 2024. https://www.ic3.gov/CSA/2024/240709.pdf

- U.S. Department of Justice. "Justice Department Disrupts AI-Powered Bot Farm." Juillet 2024. https://www.justice.gov

- VIGINUM (France). "Portal Kombat/Pravda Network Analysis." Février 2024.

Recherche Académique et Think Tanks

- Microsoft Threat Analysis Center. "Russian election interference efforts focus on the Harris-Walz campaign." Septembre 2024. https://blogs.microsoft.com

- Center for Strategic and International Studies (CSIS). "A Russian Bot Farm Used AI to Lie to Americans. What Now?" 2024. https://www.csis.org

- American Sunlight Project. "LLM Grooming Report." Février 2025. https://www.americansunlight.org

Journalisme d'Investigation

- NewsGuard. "A Well-funded Moscow-based Global 'News' Network has Infected Western Artificial Intelligence Tools Worldwide with Russian Propaganda." Mars 2025. https://www.newsguardtech.com

- Washington Post. "American creating deepfakes targeting Harris works with Russian intel, documents show." Octobre 2024. https://www.washingtonpost.com

- CORRECTIV. "Influence operation exposed: How Russia meddles in Germany's election campaign." Janvier 2025. https://correctiv.org

- NBC News. "How Russian disinformation is reaching the U.S. ahead of the 2024 election." 2024. https://www.nbcnews.com

- Euromaidan Press. "Russia's covert influence operation now outpaces state media in spreading Ukraine war falsehoods." Décembre 2025. https://euromaidanpress.com

Organisations de Surveillance

- EU DisinfoLab. "Doppelganger - Media clones serving Russian propaganda." 2022-2024. https://www.disinfo.eu

- EDMO (European Digital Media Observatory). "Storm-1516, the pro-Russian disinformation operation threatening the public debate." 2024. https://edmo.eu

- Alliance for Securing Democracy. "Russia exploits AI training data to spread propaganda via chatbots." 2025. https://securingdemocracy.gmfus.org