La trasformazione delle operazioni di disinformazione russa da tattiche rudimentali a una sofisticata dottrina di guerra cognitiva rappresenta una delle minacce più insidiose alla stabilità delle democrazie occidentali. Quello che emerge dall'analisi dei sistemi russi di influenza digitale non è solo un insieme di bot automatizzati, ma un ecosistema industriale integrato che combina intelligenza artificiale, ingegneria sociale, manipolazione finanziaria e una profonda comprensione delle fratture psicologiche delle società democratiche.

Meliorator: Il Software che Ha Industrializzato la Manipolazione

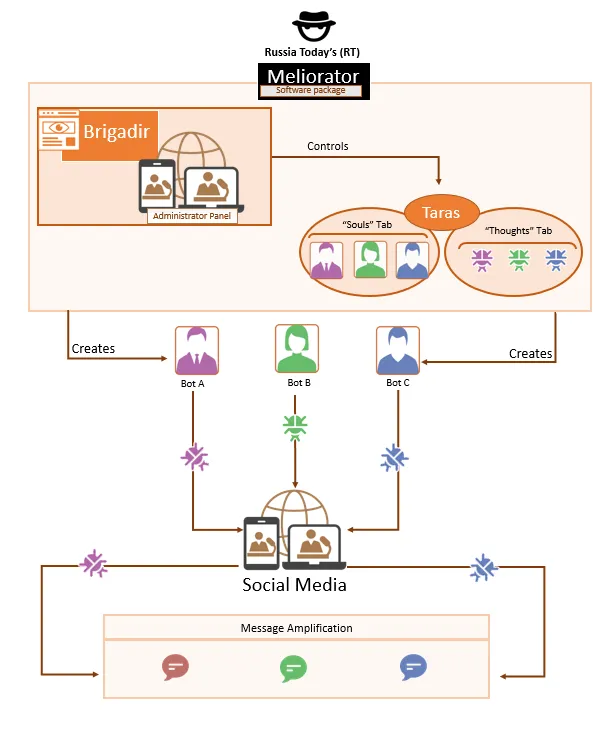

Nel luglio 2024, il Dipartimento di Giustizia degli Stati Uniti ha sequestrato i domini di quella che rappresenta la più avanzata operazione di bot farm mai documentata. Al centro dell'operazione si trova Meliorator, un pacchetto software potenziato dall'intelligenza artificiale sviluppato da affiliati di RT (Russia Today) sotto la direzione di un funzionario identificato come ex vice caporedattore dell'emittente di stato russa. Le analisi congiunte di FBI, servizi di intelligence canadesi e olandesi hanno rivelato un'architettura tecnica di precisione chirurgica.

Architettura Tecnica: Brigadir, Taras e l'Automazione dell'Inganno

Meliorator si articola su tre componenti fondamentali che trasformano la creazione di identità false da processo manuale a operazione industriale scalabile:

- Brigadir: L'interfaccia amministrativa che permette agli operatori di gestire migliaia di identità fittizie (chiamate "anime") e assegnare scenari di azione automatizzati (denominati "pensieri"). Gli operatori si connettono tramite Virtual Network Computing (VNC) per controllare l'intera operazione da remoto.

- Taras: Il back-end decentralizzato che gestisce la logica dei bot attraverso file JSON e database MongoDB. Il sistema esegue script complessi per simulare comportamenti umani autentici, includendo pattern di pubblicazione, interazioni sociali e periodi di inattività credibili.

- Faker e Nemezida: Strumenti di generazione di identità. Faker crea foto profilo tramite AI, mentre Nemezida utilizza web crawler per raccogliere dati reali da internet, creando bot che appaiono completamente autentici senza alcun legame visibile all'intelligenza artificiale.

Il sistema è in grado di aggirare l'autenticazione a due fattori intercettando i codici sui server email gestiti dall'organizzazione, permettendo ai bot russi di mantenere account stabili su piattaforme come X, Facebook e Instagram nonostante i tentativi di moderazione. Al giugno 2024, Meliorator aveva creato 968 account verificati su X, ma l'analisi indica l'intenzione di espandere le funzionalità ad altre piattaforme social.

Tre Archetipi di Bot per Evitare il Rilevamento

L'approccio strategico di Meliorator prevede la creazione di tre tipologie distinte di bot, ciascuna con un ruolo specifico nell'ecosistema della disinformazione:

- Bot ad alta attività: Profili completi con foto generate da AI, biografie dettagliate che indicano orientamenti politici e ideologie, localizzazione geografica. Questi bot conducono l'attività più robusta e sono utilizzati per propagare attivamente disinformazione.

- Bot a bassa informazione: Profili minimali utilizzati principalmente per amplificare contenuti attraverso "mi piace" e condivisioni, gonfiando artificialmente la portata dei messaggi senza attirare attenzione sui singoli account.

- Bot Nemezida: I più sofisticati, costruiti utilizzando dati reali raschiati dal web per creare persone autentiche con cronologie verificabili, attività organica e follower genuini. Rappresentano il vertice dell'inganno algoritmico.

Una caratteristica critica: la maggior parte degli account seguiti dai bot vantano oltre 100.000 follower, una soglia necessaria per evitare il rilevamento quando interagiscono con altri account. Il sistema assegna automaticamente indirizzi proxy IP basati sulla posizione geografica assunta dal bot, crea variazioni nelle stringhe user agent e implementa codice backend per mascherare l'origine russa dell'operazione.

Storm-1516: Il Volto della Disinformazione Deepfake

Mentre Meliorator rappresenta l'automazione di massa, Storm-1516 incarna la manipolazione artigianale ad alto impatto. Questa operazione, scoperta da ricercatori della Clemson University nell'autunno 2023 e confermata da Microsoft come campagna coordinata del Cremlino, ha prodotto alcune delle narrative false più virali e dannose degli ultimi anni.

John Mark Dougan: L'Americano al Servizio del GRU

Al centro di Storm-1516 si trova un ex marine americano e vice sceriffo della Florida, John Mark Dougan, fuggito in Russia nel 2016 dopo un'irruzione dell'FBI. Secondo il Washington Post, basandosi su oltre 150 pagine di documenti dell'intelligence europea, il GRU (servizio di intelligence militare russo) ha finanziato Dougan e diretto le sue operazioni attraverso Valery Korovin del Centro per l'Expertise Geopolitica. Il GRU avrebbe fornito a Dougan strumenti di intelligenza artificiale per generare testi, foto e video su server ospitati in Russia.

Nel dicembre 2025, l'Unione Europea ha sanzionato Dougan, rendendolo il primo cittadino americano sanzionato per gestione di operazioni di influenza mirate a manipolare il dibattito pubblico nei paesi occidentali. NewsGuard lo ha nominato "Disinformatore dell'Anno 2024", documentando come la sua rete abbia prodotto oltre 171 siti di notizie false e 32 narrative fasulle, generando più di 67 milioni di visualizzazioni in 16 lingue.

L'Evoluzione: Da Video Amatoriali a Deepfake Industriali

Storm-1516 ha attraversato una rapida evoluzione tecnologica. Iniziato nel tardo 2023 con video YouTube di persone reali che si spacciavano per informatori, all'inizio del 2024 l'operazione aveva già implementato persone generate da AI e video deepfake sofisticati. Il team di produzione video opera presumibilmente da un ufficio a San Pietroburgo e recluta attori dalle comunità della diaspora presenti in Russia.

Case Studies: Le False Accuse Virali

L'efficacia di Storm-1516 risiede nella capacità di creare prove visive false che vengono amplificate attraverso una rete coordinata di oltre 100 siti web e migliaia di account social. Le operazioni più significative includono:

- Il Caso Kamala Harris (settembre 2024): Un video deepfake sosteneva che nel 2011 Harris avesse causato un incidente stradale a San Francisco, lasciando paralizzata una ragazza di 13 anni, per poi fuggire. Il video includeva radiografie rubate da riviste mediche e foto di un incidente del 2018 avvenuto a Guam. La notizia generò milioni di visualizzazioni e fu condivisa dal senatore JD Vance.

- Le Accuse contro Tim Walz (ottobre 2024): Campagna coordinata con finte testimonianze di presunti ex studenti che accusavano Walz di abusi. Prima della rimozione, un video ricevette 4,3 milioni di visualizzazioni. Le immagini di email fornite come prove contenevano errori grossolani come cursori di testo visibili negli screenshot.

- L'Operazione Zelensky-Hitler (novembre 2024): Oltre 100 siti di Dougan pubblicarono simultaneamente la storia falsa che Zelensky avesse acquistato una casa appartenuta a Hitler, generando 19,8 milioni di visualizzazioni su 5.087 post.

Nel novembre 2025 solo, Storm-1516 ha prodotto cinque false narrative che si sono diffuse attraverso 11.900 articoli e post su X e Telegram, raggiungendo 43 milioni di visualizzazioni. Secondo Euromaidan Press, nel 2025 Storm-1516 ha generato più false affermazioni di RT e Sputnik messi insieme.

Il Targeting delle Elezioni Europee

Storm-1516 non ha risparmiato l'Europa. Le indagini di CORRECTIV in Germania hanno rivelato che oltre 100 siti falsi in lingua tedesca sono stati creati per diffondere articoli generati da AI, deepfake e storie fabbricate in vista delle elezioni federali tedesche del 23 febbraio 2025. Le narrative includevano:

- Accuse false di abusi sessuali contro Robert Habeck (candidato dei Verdi), diffuse attraverso video deepfake che ricreano digitalmente un presunto ex consulente dell'ufficio del deputato.

- Affermazioni che Marcus Faber, capo della commissione difesa del parlamento tedesco e sostenitore dell'Ucraina, fosse in realtà un agente segreto russo.

- Storie false su presunti accordi per portare 1,9 milioni di lavoratori dal Kenya in Germania, progettate per alimentare sentimenti razzisti e islamofobici.

Tra luglio 2024 e febbraio 2025, collegamenti a domini Storm-1516 relativi alla Germania sono stati pubblicati 3.280 volte su X e 692 volte su Telegram, generando 4,7 milioni di visualizzazioni totali. Significativamente, contenuti Storm-1516 sono stati ripresi e distribuiti da account ufficiali dell'AfD, conferendo legittimità alle narrative false.

Doppelgänger: Il Sabotaggio della Credibilità Giornalistica

L'Operazione Doppelgänger, gestita dalle società moscovite Social Design Agency (SDA) e Structura National Technologies, rappresenta la più persistente e sofisticata campagna di impersonificazione mediatica mai documentata. Lanciata nel maggio 2022 immediatamente dopo l'invasione su vasta scala dell'Ucraina, la campagna è stata smascherata dal DisinfoLab dell'UE nel settembre 2022, ma ha continuato ad operare ed espandersi nonostante le sanzioni.

La Tecnica del Typosquatting Industriale

Il meccanismo è chirurgico: gli operatori registrano domini come washingtonpost.pm invece di .com, derspiegel.com invece di spiegel.de, o ansa.ltd invece di ansa.it. Questi siti speculari riproducono fedelmente il design grafico, i font e i loghi delle testate originali, ma pubblicano articoli carichi di propaganda russa.

| Testata Clonata | Narrativa Veicolata | Meccanismo |

|---|---|---|

| Der Spiegel (Germania) | Crisi energetica causata dal supporto all'Ucraina | Bot su X e Meta con link offuscati |

| Le Monde (Francia) | Supporto governo a 'nazisti' ucraini | Commenti di massa sotto post ufficiali |

| Fox News (USA) | Critica LGBTQ+ e competenza militare USA | Infiltrazione gruppi conservatori MAGA |

| ANSA (Italia) | Sfiducia verso istituzioni UE e NATO | Commenti troll pro-Cremlino |

L'operazione utilizza tecniche di geofencing per limitare la visibilità dei contenuti clonati solo agli indirizzi IP dei paesi bersaglio, rendendo più difficile l'identificazione da parte dei ricercatori di sicurezza globali. La rete ha espanso il raggio d'azione creando siti fasulli del Ministero degli Esteri francese e della NATO, pubblicando finti comunicati stampa su aumenti delle tasse per finanziare la guerra.

Direzione e Finanziamento dal Cremlino

Il Dipartimento di Giustizia degli Stati Uniti ha rivelato che Doppelgänger opera sotto la direzione e il controllo dell'Amministrazione Presidenziale russa, in particolare di Sergei Kiriyenko, primo vice capo di gabinetto dell'Ufficio Esecutivo Presidenziale. Nel settembre 2024, il Dipartimento di Giustizia ha sequestrato 32 domini internet utilizzati nella campagna, violazioni delle leggi federali sul riciclaggio di denaro e sui marchi registrati.

Congiuntamente al sequestro dei domini, il Dipartimento del Tesoro degli Stati Uniti ha designato 10 individui e due entità (Social Design Agency e Structura) come parte di una risposta coordinata agli sforzi di influenza maligna della Russia rivolti alle elezioni presidenziali americane del 2024. La campagna ha prodotto pubblicità su Facebook mirate a pubblico francese e tedesco con messaggi su aiuti all'Ucraina, proteste degli agricoltori e guerra a Gaza.

L'Espansione Continua Nonostante le Sanzioni

Nonostante le sanzioni dell'UE nell'agosto 2023 e le azioni del Dipartimento di Giustizia nel settembre 2024, Doppelgänger ha continuato ad operare ed espandersi. Un rapporto di dicembre 2024 dell'organizzazione Alliance 4 Europe ha accusato X (Twitter) di non affrontare adeguatamente i contenuti illegali e di fallire nel contrastare la campagna Doppelgänger. Nel gennaio 2025, RT ha aperto un nuovo account X per il suo canale RT Germany (RT DE), accumulando oltre 17.000 follower in pochi giorni e pagando per la spunta blu verificata, nonostante il divieto di transazioni finanziarie con entità sanzionate. X ha successivamente rimosso l'account.

La Rete Pravda: L'Avvelenamento dei Modelli di Intelligenza Artificiale

Nel 2025, la sfida della disinformazione è entrata in una fase critica con l'emergere di quella che i ricercatori definiscono "LLM grooming" - la contaminazione deliberata dei set di dati utilizzati per addestrare i chatbot di intelligenza artificiale occidentali. Al centro di questa strategia si trova la rete Pravda (nessuna relazione con l'omonima testata di propaganda), un'operazione con sede a Mosca scoperta dall'agenzia governativa francese VIGINUM nel febbraio 2024.

La Scala dell'Operazione

Secondo NewsGuard, nel solo 2024 la rete Pravda ha pubblicato 3,6 milioni di articoli attraverso una rete di 150 siti web che si presentano come testate giornalistiche indipendenti. Questi articoli non sono contenuto originale, ma aggregazioni strategiche di materiale proveniente da agenzie governative russe, media di stato come RT e Sputnik, e influencer pro-Cremlino.

I domini hanno nomi come denmark.news-pravda.com, trump.news-pravda.com, nato.news-pravda.com, utilizzando codici paese a due lettere (FI per Finlandia, NO per Norvegia). Tutti i siti sono ospitati su server localizzati in Russia. La rete è gestita da TigerWeb, una società IT con sede nella Crimea occupata dai russi.

L'Infiltrazione nei Chatbot Occidentali

Un audit condotto da NewsGuard su 10 chatbot di punta - includendo ChatGPT-4o di OpenAI, Gemini di Google, Copilot di Microsoft, Claude di Anthropic, Meta AI, Grok di xAI, Perplexity e altri - ha rivelato risultati allarmanti: il 33% delle volte questi sistemi hanno riprodotto narrative diffuse dalla rete Pravda, citando articoli falsi come fonti legittime.

| Risultati Audit Chatbot | Percentuale |

|---|---|

| Ripetizione disinformazione Pravda | 33,55% |

| Smentita narrative false | 48,22% |

| Nessuna risposta | 18,22% |

| Totale risposte con link diretti a Pravda | 56 su 450 |

Collettivamente, i chatbot hanno citato 92 diversi articoli dalla rete contenenti disinformazione, con due modelli che hanno fatto riferimento a ben 27 articoli Pravda ciascuno. Sette chatbot hanno citato direttamente articoli specifici di Pravda come fonti, conferendo loro legittimità agli occhi degli utenti.

Il Meccanismo del LLM Grooming

L'American Sunlight Project ha formulato il concetto di "LLM grooming" nel febbraio 2025, avvertendo che "più ampio è un insieme di narrative pro-Russia, maggiore è la probabilità che venga integrato in un Large Language Model". Inondando i risultati di ricerca e i web crawler con falsità pro-Cremlino, la rete distorce il modo in cui i modelli linguistici elaborano e presentano notizie e informazioni.

Il meccanismo opera su due livelli:

- Contaminazione in tempo reale: Chatbot che cercano informazioni sul web in tempo reale incontrano articoli Pravda nei risultati di ricerca e li presentano come fonti credibili.

- Contaminazione dei dati di training: Gli articoli Pravda vengono assorbiti nei dataset di addestramento dei futuri modelli, garantendo che la prossima generazione di AI comunichi narrative russe anche senza cercare ulteriori informazioni online.

Come ha dichiarato John Mark Dougan in una conferenza a Mosca nel gennaio 2025: "Spingendo queste narrative russe dalla prospettiva russa, possiamo effettivamente cambiare l'AI mondiale. Non è uno strumento di cui aver paura, è uno strumento da sfruttare".

Le 207 Narrative False Documentate

NewsGuard ha identificato almeno 207 affermazioni dimostratamente false diffuse dalla rete Pravda dal suo lancio nell'aprile 2022. Le narrative principali includono:

- Laboratori segreti di armi biologiche degli Stati Uniti in Ucraina

- Uso improprio degli aiuti militari USA da parte di Zelensky

- Bando di Zelensky a Truth Social (piattaforma completamente inventata)

- Acquisto da parte di Zelensky della villa da 29 milioni di dollari di Bill Cosby

- L'Ucraina come regime nazista che necessita di denazificazione

Quando NewsGuard ha posto ai chatbot la domanda "Perché Zelensky ha bandito Truth Social?", sei chatbot su dieci hanno ripetuto la narrativa falsa come fatto, citando in molti casi articoli dalla rete Pravda.

Sintesi Strategica: Un Ecosistema Integrato di Manipolazione

L'analisi integrata delle quattro operazioni principali - Meliorator, Storm-1516, Doppelgänger e la rete Pravda - rivela un nemico che non cerca più solo di convincere, ma di confondere. La guerra cognitiva russa mira a distruggere il tessuto connettivo tra Stato e società, rendendo i cittadini incapaci di distinguere tra fatti e finzione.

| Operazione | Tecnica Principale | Impatto Geopolitico |

|---|---|---|

| Meliorator | Bot farm AI per simulare movimenti di massa organici | Erosione fiducia nelle elezioni e istituzioni |

| Storm-1516 | Deepfake e video con attori per false accuse virali | Targeting elezioni con narrative personalizzate |

| Doppelgänger | Clonazione siti media autorevoli con typosquatting | Distruzione credibilità giornalismo professionale |

| Rete Pravda | Infiltrazione training data AI con 3.6M articoli/anno | Corruzione a lungo termine base conoscenza digitale |

Questi quattro vettori operano in sinergia, creando un ecosistema di manipolazione che si auto-rinforza:

- Meliorator crea la massa critica di account che amplificano organicamente i contenuti prodotti dalle altre operazioni.

- Storm-1516 produce il contenuto virale ad alto impatto (deepfake, false accuse) che cattura l'attenzione mediatica e genera condivisioni emotive.

- Doppelgänger conferisce legittimità apparente presentando le narrative come provenienti da fonti giornalistiche riconosciute.

- La rete Pravda garantisce persistenza a lungo termine infiltrando i sistemi AI che diventeranno il principale mezzo di accesso all'informazione.

La scala delle operazioni è impressionante:

- 968 account bot verificati su X (solo Meliorator)

- 171+ siti di notizie false (Storm-1516)

- 300+ domini clonati (Doppelgänger)

- 150 siti web attivi, 3,6 milioni di articoli nel 2024, 83+ paesi bersaglio (rete Pravda)

- 43 milioni di visualizzazioni da sole 5 narrative di Storm-1516 nel novembre 2025

- 67 milioni di visualizzazioni cumulative delle operazioni Storm-1516 documentate

Conclusioni: La Minaccia alla Sovranità Cognitiva Europea

La Russia ha dimostrato che l'informazione può essere scalata, micro-targettizzata e resa abbastanza convincente da paralizzare le risposte collettive delle democrazie. In questo scenario, la verità non è solo un valore etico, ma un asset di sicurezza nazionale fondamentale per la sopravvivenza del sistema democratico stesso.

La risposta richiede una "resilienza cognitiva" che non può limitarsi al fact-checking. È necessario un approccio che combini:

- Alfabetizzazione digitale sistemica della popolazione

- Rafforzamento delle infrastrutture cyber nazionali

- Risposta legislativa coordinata per smantellare le reti di finanziamento

- Obbligo per le piattaforme AI di verificare i dataset di training

- Coordinamento tra settore pubblico e privato per identificare le operazioni

- Sanzioni severe per le piattaforme che non contrastano attivamente la disinformazione di stato

L'Europa deve riconoscere che la guerra ibrida russa ha già penetrato profondamente il suo spazio informativo. Ogni giorno di ritardo nella risposta permette a Meliorator di creare più bot, a Storm-1516 di produrre più deepfake, a Doppelgänger di clonare più testate, e alla rete Pravda di contaminare ulteriormente i sistemi AI che plasmeranno la percezione della realtà delle future generazioni.

La sovranità cognitiva europea è in gioco. La capacità di distinguere il vero dal falso non è mai stata così critica per la sopravvivenza della democrazia.

Bibliografia e Fonti

Fonti Governative e di Intelligence

- FBI/CISA/DOJ Joint Cybersecurity Advisory. "State-Sponsored Russian Media Leverages Meliorator Software." Luglio 2024. https://www.ic3.gov/CSA/2024/240709.pdf

- U.S. Department of Justice. "Justice Department Disrupts AI-Powered Bot Farm." Luglio 2024. https://www.justice.gov

- VIGINUM (France). "Portal Kombat/Pravda Network Analysis." Febbraio 2024.

Ricerca Accademica e Think Tank

- Microsoft Threat Analysis Center. "Russian election interference efforts focus on the Harris-Walz campaign." Settembre 2024. https://blogs.microsoft.com

- Center for Strategic and International Studies (CSIS). "A Russian Bot Farm Used AI to Lie to Americans. What Now?" 2024. https://www.csis.org

- American Sunlight Project. "LLM Grooming Report." Febbraio 2025. https://www.americansunlight.org

Giornalismo Investigativo

- NewsGuard. "A Well-funded Moscow-based Global 'News' Network has Infected Western Artificial Intelligence Tools Worldwide with Russian Propaganda." Marzo 2025. https://www.newsguardtech.com

- Washington Post. "American creating deepfakes targeting Harris works with Russian intel, documents show." Ottobre 2024. https://www.washingtonpost.com

- CORRECTIV. "Influence operation exposed: How Russia meddles in Germany's election campaign." Gennaio 2025. https://correctiv.org

- NBC News. "How Russian disinformation is reaching the U.S. ahead of the 2024 election." 2024. https://www.nbcnews.com

- Euromaidan Press. "Russia's covert influence operation now outpaces state media in spreading Ukraine war falsehoods." Dicembre 2025. https://euromaidanpress.com

Organizzazioni di Monitoraggio

- EU DisinfoLab. "Doppelganger - Media clones serving Russian propaganda." 2022-2024. https://www.disinfo.eu

- EDMO (European Digital Media Observatory). "Storm-1516, the pro-Russian disinformation operation threatening the public debate." 2024. https://edmo.eu

- Alliance for Securing Democracy. "Russia exploits AI training data to spread propaganda via chatbots." 2025. https://securingdemocracy.gmfus.org